C介绍

C-Eval排行榜是面向中文大语言模型的权威评估基准平台,专注于全面衡量模型在多层次、多学科任务中的综合能力。它覆盖初中至专业级共52个学科,包含近1.4万道人工标注的选择题,题目格式多样且严格防数据污染,确保评测公平可靠。平台支持Answer-Only和Chain-of-Thought两种评估模式,并特别设立高难度子集C-Eval Hard以检验深度推理能力;开发者可提交预测结果参与自动评分与实时排名,同时提供开发集与验证集供研究使用。

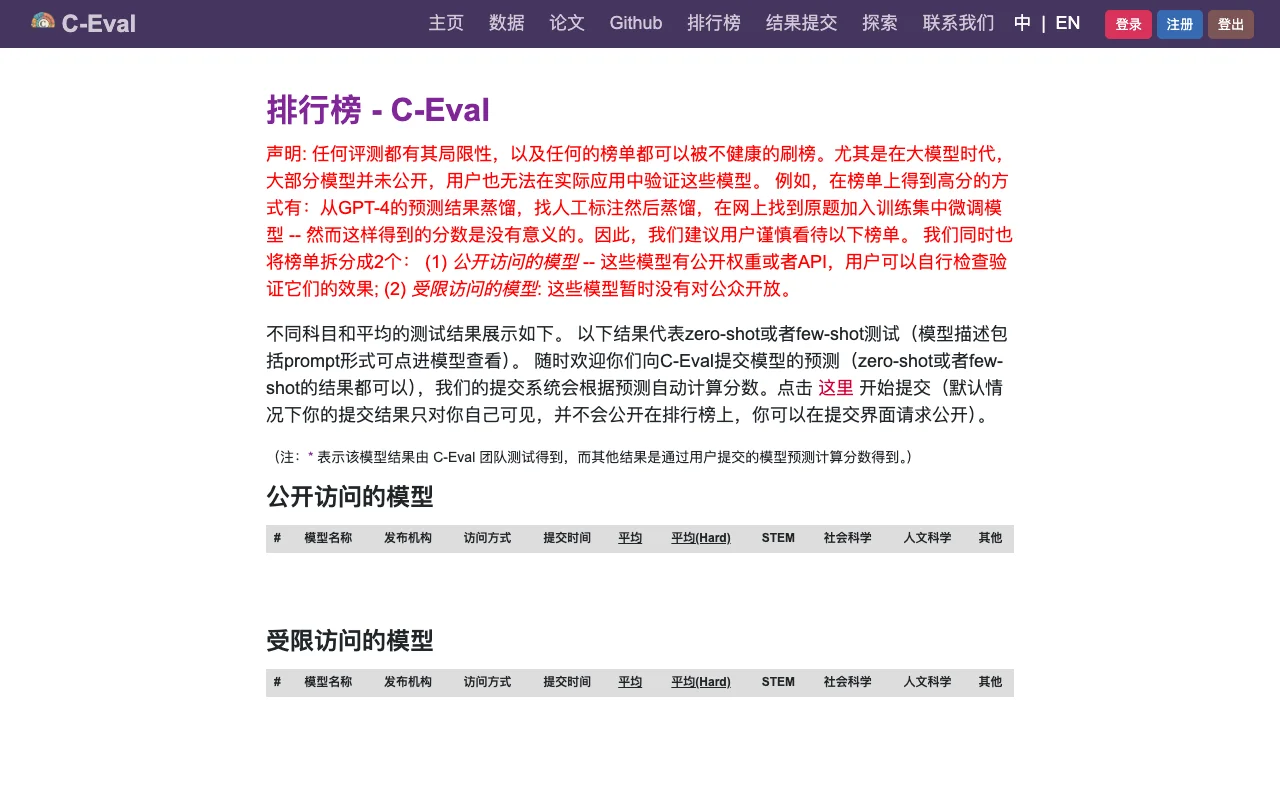

C网站截图

C的主要功能

- 提供实时更新的中文大模型综合能力排行榜

- 支持52个学科、四大难度级别的多层次评估体系

- 包含13948道人工标注选择题,严格规避训练数据泄露

- 设有C-Eval Hard高难度子集,聚焦高等数学等8个挑战科目

- 支持Answer-Only与Chain-of-Thought双评估模式

- 开放测试集提交通道,系统自动生成分数并更新排名

- 采用LaTeX等非结构化格式与人工审核保障数据纯净性

C如何使用

- 访问官网进入C-Eval排行榜页面

- 浏览当前主流模型的综合得分与学科表现

- 下载开发集或验证集用于本地模型测试

- 按规范格式准备模型预测结果文件

- 通过网站提交预测结果获取自动评分

- 查看生成的详细学科分析报告与排名变化

- 参考官方文档或论文深入理解评估方法与指标

C的应用场景

- 模型研发团队用于识别特定学科能力短板并优化训练策略

- 企业技术选型时参考不同模型在教育、医疗、法律等垂直领域的表现

- 高校与科研机构开展中文大模型多任务学习、推理机制等学术研究

- AI产品经理评估模型落地可行性,匹配实际业务场景需求

- 开发者社区开展模型对比实验与开源项目能力验证

- 教育科技公司设计智能辅导系统时筛选适配的底层语言模型

- 监管与标准机构参考其评估框架构建中文AI能力认证体系

暂无评论,来发表第一条评论吧!