HELM介绍

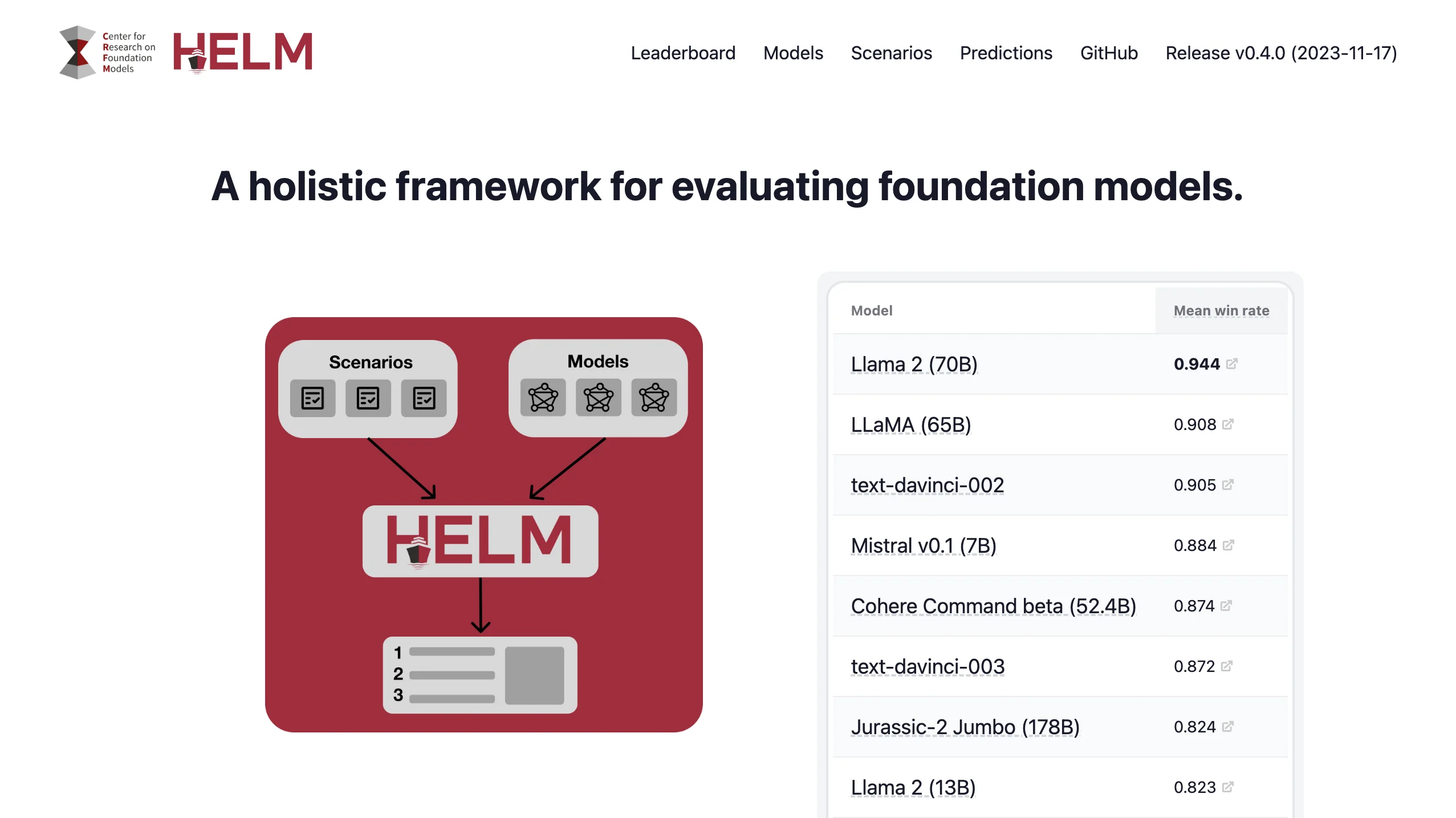

HELM(Holistic Evaluation of Language Models)是由斯坦福大学基础模型研究中心(CRFM)推出的开源大模型评测体系,致力于通过多维度、多场景、可复现的方式全面评估大型语言模型的性能。它不仅关注传统准确性,更涵盖校准性、鲁棒性、公平性、偏见、毒性与效率等七大核心指标,并覆盖42个真实世界任务场景,如问答、摘要、情感分析及伦理安全检测。平台以‘活的基准’为理念,持续更新数百个主流模型(如GPT系列、Llama)的排行榜,支持Web交互式分析与本地代码化评估,2025年已扩展出HELM Capabilities、MedHELM和HELM-Safety等专业化变体,兼顾学术研究与工业落地需求。

HELM网站截图

HELM的主要功能

- 提供数百个大模型的多维度性能排行榜,支持按场景和指标灵活筛选

- 同时评估准确性、校准性、鲁棒性、公平性、偏见、毒性和效率七大指标

- 覆盖16个原始论文场景与42个真实世界任务,集成GLUE、TruthfulQA等数十个权威数据集

- 内置Web UI交互式仪表盘,可查看提示输入、模型响应及详细日志可视化

- 开源GitHub工具链(stanford-crfm/helm),支持本地或云端运行自定义评估

HELM如何使用

- 访问官网https://crfm.stanford.edu/helm/classic/latest/,无需注册即可浏览排行榜和结果

- 在Web界面中选择目标模型、任务场景与评估指标,查看交互图表与详细报告

- 克隆GitHub仓库并安装依赖,配置API密钥后运行helm-run命令执行自定义评估

- 使用helm-summarize工具自动汇总生成的评估结果与指标得分

- 关注官方发布日志或RSS订阅,及时获取HELM Capabilities等新变体更新信息

HELM的应用场景

- 学术研究中对新模型(如Llama 3)进行多指标基准测试与横向对比

- 企业AI团队开展模型伦理审计,识别偏见、毒性等合规风险

- 开发者优化产品提示工程或微调策略,结合效率与准确性做权衡决策

- 医疗、金融等垂直领域验证模型专业能力,如通过MedHELM评估诊疗问答质量

- 教学与入门学习,借助Web UI直观理解大模型在不同任务中的表现差异

暂无评论,来发表第一条评论吧!