📋 liteLLM介绍

liteLLM是一款开源的大型语言模型(LLM)网关工具,旨在统一接入和管理100多个主流LLM提供商(如OpenAI、Anthropic、Gemini、Bedrock、Azure等),将各异构API标准化为OpenAI兼容格式,大幅降低多模型集成复杂度。它支持开箱即用的负载均衡、故障自动回退、实时成本追踪、RPM/TPM限速、虚拟密钥与团队预算控制,并深度集成Langfuse、LangSmith等可观测性工具,兼顾安全性与可审计性,已被Netflix、RocketMoney等企业用于生产环境。

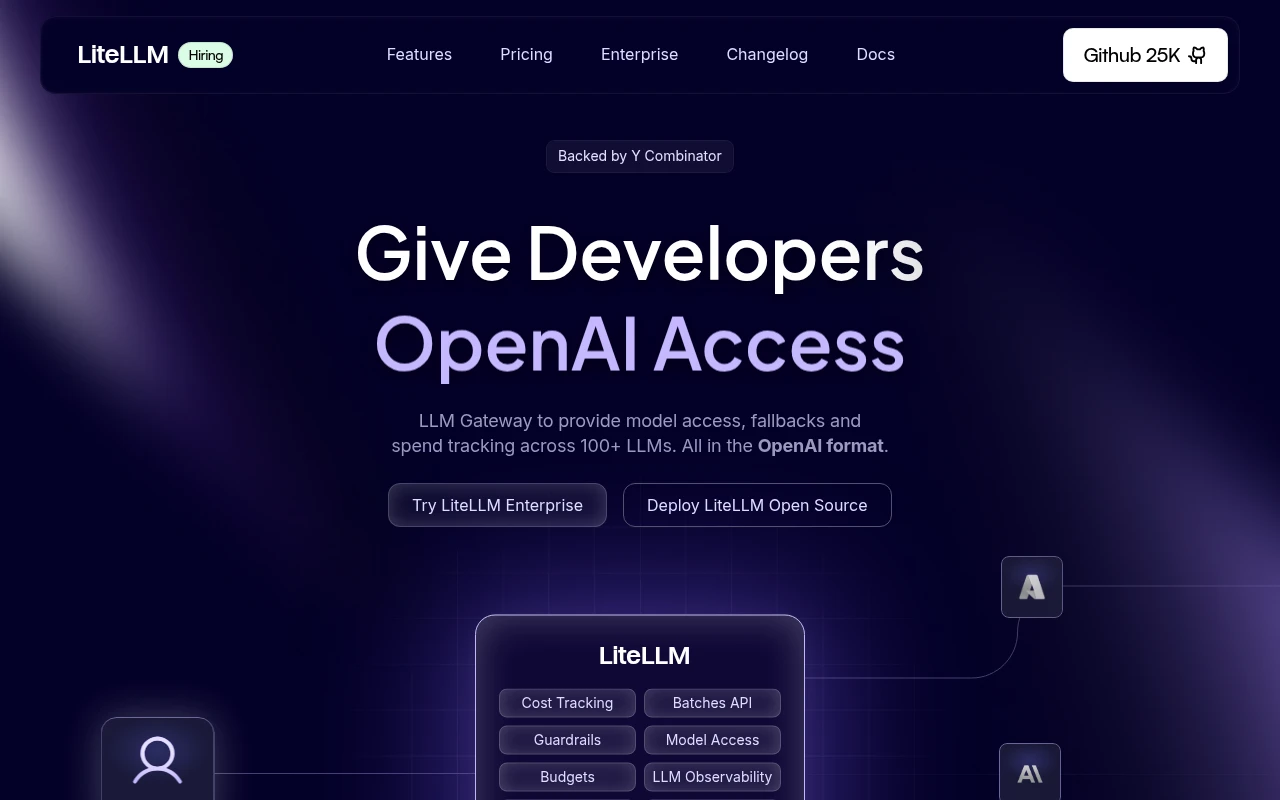

📷 liteLLM网站截图

⭐ liteLLM的主要功能

- 支持100+ LLM提供商的统一API接入

- 自动负载均衡与模型故障回退机制

- 细粒度成本追踪、预算控制与速率限制

- 多平台日志集成(Langfuse/Arize/OTEL/S3)

- 内置LLM防护栏与透传请求能力

- 虚拟密钥管理与团队级访问控制

📘 liteLLM如何使用

- 通过pip安装liteLLM或拉取Docker镜像启动服务

- 配置环境变量或YAML文件添加各LLM提供商密钥与模型映射

- 使用标准OpenAI SDK发起请求,自动路由至目标模型

- 启用监控插件(如Langfuse)实现调用链追踪与分析

- 为不同团队生成虚拟密钥并设置独立预算与限流规则

🚀 liteLLM的应用场景

- 企业内部LLM服务平台统一纳管与权限分发

- 多模型A/B测试与动态路由调度场景

- SaaS产品快速集成多种大模型能力而不绑定单一厂商

- 开发者实验环境一键切换模型与供应商

- 合规敏感型业务中实现调用审计、成本归因与输出防护

标签

🔗 相关推荐

🔥 热门工具

🆕 最新收录

评论

暂无评论,来发表第一条评论吧!