MMLU介绍

MMLU(Massive Multitask Language Understanding)是一个权威的大语言模型评测基准,专注于衡量模型在跨学科、多任务场景下的综合语言理解能力。它涵盖57个细分领域,包括数学、物理、法律、医学、历史等,题目形式为标准多选题,难度覆盖高中至专业水平,以准确率作为核心评估指标。该基准被全球研究机构和AI公司广泛采用,是判断模型知识广度与推理深度的关键标尺,也是Papers with Code等平台持续追踪SOTA进展的核心榜单之一。

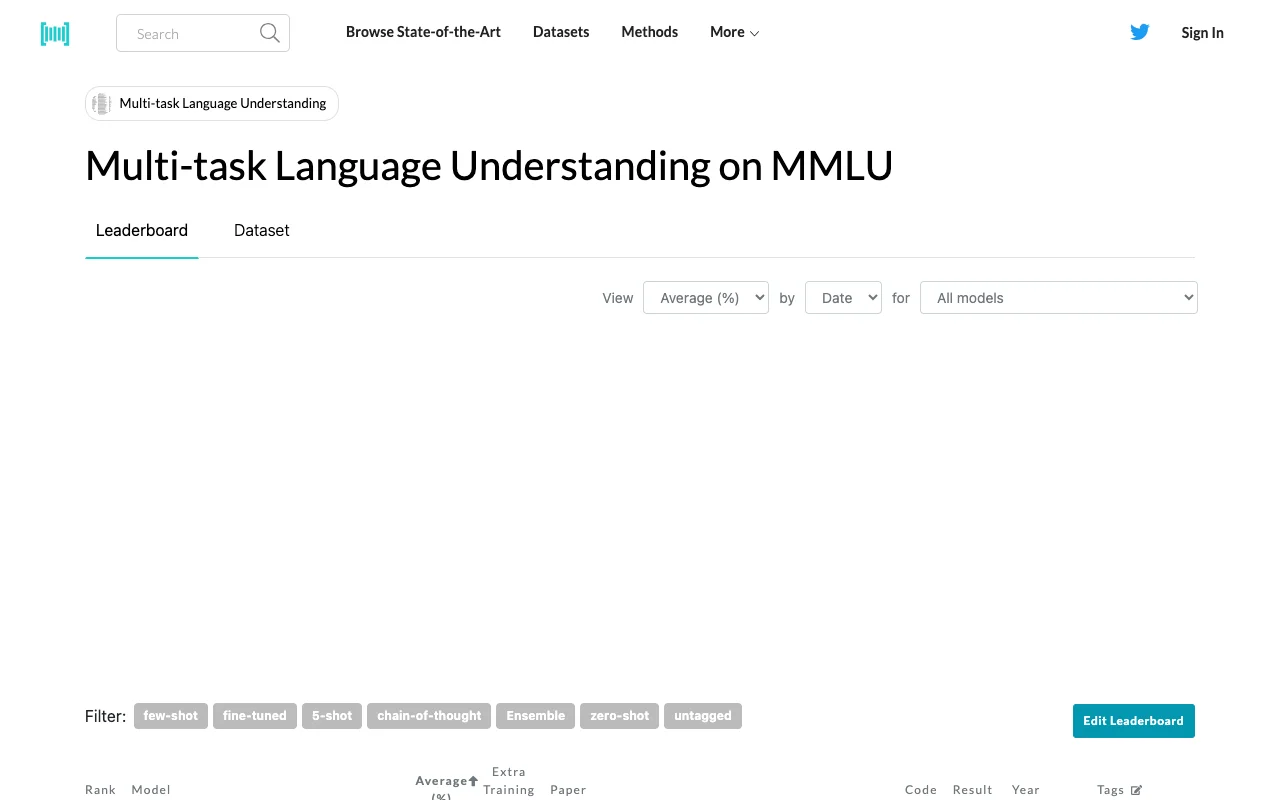

MMLU网站截图

MMLU的主要功能

- 覆盖57个学科领域的多任务评测

- 采用标准化多选题形式,确保评估客观可比

- 以整体准确率及子领域得分双维度呈现模型能力

- 支持模型间横向性能对比与技术路径分析

- 数据公开、结果可复现,具备强学术公信力

MMLU如何使用

- 访问Papers with Code的MMLU排行榜页面

- 浏览当前排名前列的模型及其准确率数据

- 点击具体模型查看对应论文、开源代码及实验细节

- 参考子任务得分分析模型在不同学科的表现强弱

- 结合自身需求选择适配的模型或方法进行复现或优化

MMLU的应用场景

- 研究人员评估新模型在多学科理解上的突破性表现

- AI工程师筛选适合教育、法律或医疗垂直场景的基础模型

- 高校教师设计课程内容时了解当前AI的知识边界

- 开发者验证自研模型在通用语言理解任务中的达标程度

- 技术决策者横向对比主流大模型的实际认知能力水平

暂无评论,来发表第一条评论吧!